Arxiv今日论文 | 2026-04-02

本篇博文主要内容为 2026-04-02 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-04-02)

今日共更新663篇论文,其中:

自然语言处理共106篇(Computation and Language (cs.CL))

人工智能共173篇(Artificial Intelligence (cs.AI))

计算机视觉共136篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共164篇(Machine Learning (cs.LG))

多智能体系统共18篇(Multiagent Systems (cs.MA))

信息检索共1 ...

Arxiv今日论文 | 2026-04-01

本篇博文主要内容为 2026-04-01 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-04-01)

今日共更新644篇论文,其中:

自然语言处理共76篇(Computation and Language (cs.CL))

人工智能共201篇(Artificial Intelligence (cs.AI))

计算机视觉共135篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共134篇(Machine Learning (cs.LG))

多智能体系统共13篇(Multiagent Systems (cs.MA))

信息检索共17 ...

Arxiv今日论文 | 2026-03-31

本篇博文主要内容为 2026-03-31 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-31)

今日共更新1190篇论文,其中:

自然语言处理共120篇(Computation and Language (cs.CL))

人工智能共337篇(Artificial Intelligence (cs.AI))

计算机视觉共336篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共280篇(Machine Learning (cs.LG))

多智能体系统共25篇(Multiagent Systems (cs.MA))

信息检索共 ...

Arxiv今日论文 | 2026-03-30

本篇博文主要内容为 2026-03-30 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-30)

今日共更新487篇论文,其中:

自然语言处理共55篇(Computation and Language (cs.CL))

人工智能共117篇(Artificial Intelligence (cs.AI))

计算机视觉共138篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共123篇(Machine Learning (cs.LG))

多智能体系统共6篇(Multiagent Systems (cs.MA))

信息检索共6篇( ...

Arxiv今日论文 | 2026-03-27

本篇博文主要内容为 2026-03-27 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-27)

今日共更新582篇论文,其中:

自然语言处理共67篇(Computation and Language (cs.CL))

人工智能共178篇(Artificial Intelligence (cs.AI))

计算机视觉共172篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共129篇(Machine Learning (cs.LG))

多智能体系统共18篇(Multiagent Systems (cs.MA))

信息检索共15 ...

Arxiv今日论文 | 2026-03-26

本篇博文主要内容为 2026-03-26 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-26)

今日共更新573篇论文,其中:

自然语言处理共97篇(Computation and Language (cs.CL))

人工智能共166篇(Artificial Intelligence (cs.AI))

计算机视觉共135篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共162篇(Machine Learning (cs.LG))

多智能体系统共10篇(Multiagent Systems (cs.MA))

信息检索共22 ...

Arxiv今日论文 | 2026-03-25

本篇博文主要内容为 2026-03-25 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-25)

今日共更新668篇论文,其中:

自然语言处理共81篇(Computation and Language (cs.CL))

人工智能共212篇(Artificial Intelligence (cs.AI))

计算机视觉共157篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共173篇(Machine Learning (cs.LG))

多智能体系统共8篇(Multiagent Systems (cs.MA))

信息检索共19篇 ...

Arxiv今日论文 | 2026-03-24

本篇博文主要内容为 2026-03-24 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-24)

今日共更新1176篇论文,其中:

自然语言处理共152篇(Computation and Language (cs.CL))

人工智能共362篇(Artificial Intelligence (cs.AI))

计算机视觉共270篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共319篇(Machine Learning (cs.LG))

多智能体系统共29篇(Multiagent Systems (cs.MA))

信息检索共 ...

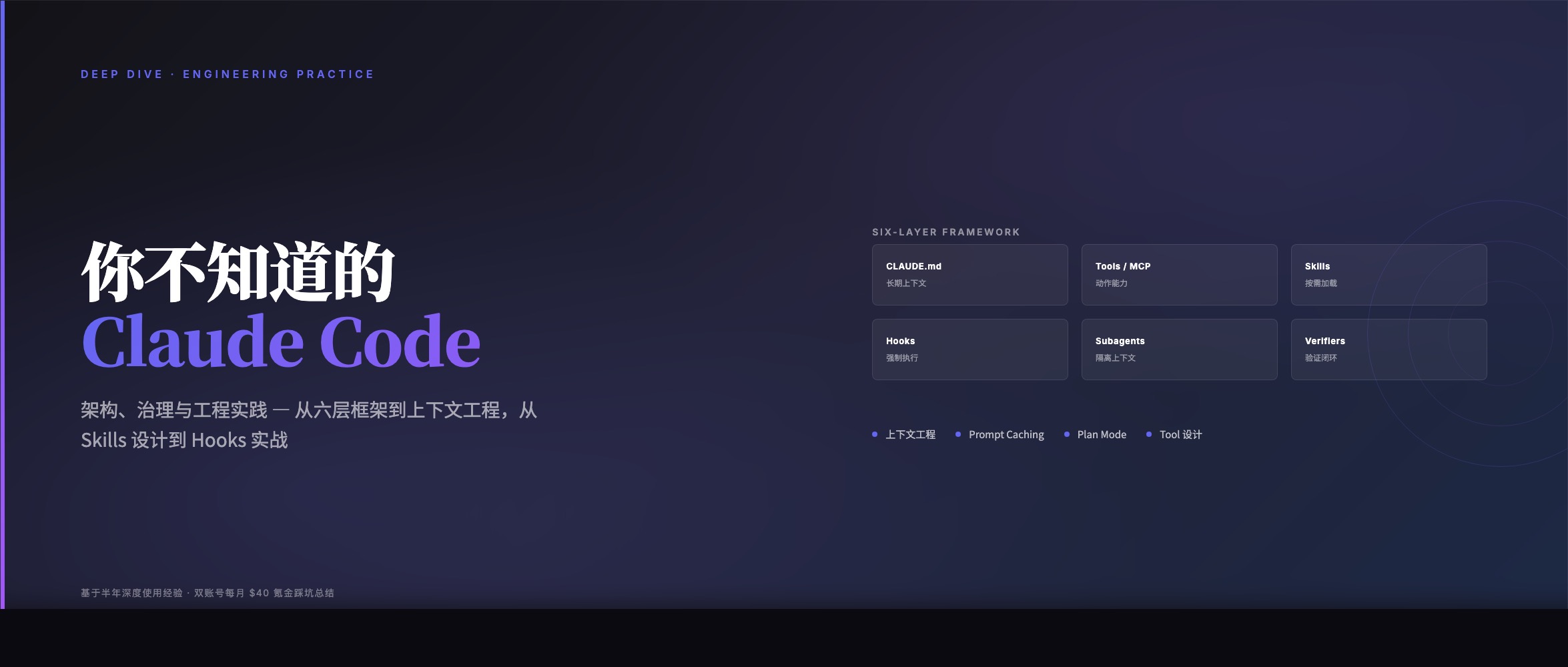

你不知道的 Claude Code:架构、治理与工程实践

0. 太长不读

今天这篇文章源于最近半年深度使用 Claude Code、两个账号每月 40 刀氪金换来的一些踩坑经验,希望能给大伙一些输入。

刚开始我也把它当 ChatBot 用,后来很快发现不对劲:上下文越来越乱、工具越来越多但效果越来越差、规则越写越长却越不遵守,折腾了一段时间,研究了 Claude Code 本身之后才意识到,这不是 Prompt 问题,而是这套系统的设计就是这样的。

这篇文章想和大伙聊聊这几个事:Claude Code 底层怎么运作、上下文为什么会乱以及怎么治理、Skills 和 Hooks 应该怎么设计、Subagents 的正确用法、Prompt Caching 的架构影响,以及怎么写一个真正有用的 CLAUDE.md。

我觉得最直接的理解方式,是把 Claude Code 拆成六层来看:

层

职责

CLAUDE.md / rules / memory

长期上下文,告诉 Claude “是什么”

Tools / MCP

动作能力,告诉 Claude “能做什么”

Skills

按需加载的方法论,告诉 Claude “怎么做”

Ho ...

Arxiv今日论文 | 2026-03-23

本篇博文主要内容为 2026-03-23 从Arxiv.org论文网站获取的最新论文列表,自动更新,按照NLP、CV、ML、AI、IR、MA六个大方向区分。

说明:每日论文数据从Arxiv.org获取,每天早上12:30左右定时自动更新。

提示: 当天未及时更新,有可能是Arxiv当日未有新的论文发布,也有可能是脚本出错。尽可能会在当天修复。

目录

概览

自然语言处理CL

多智能体系统MA

信息检索IR

人机交互HC

人工智能AI

机器学习LG

计算机视觉CV

概览 (2026-03-23)

今日共更新555篇论文,其中:

自然语言处理共94篇(Computation and Language (cs.CL))

人工智能共168篇(Artificial Intelligence (cs.AI))

计算机视觉共132篇(Computer Vision and Pattern Recognition (cs.CV))

机器学习共154篇(Machine Learning (cs.LG))

多智能体系统共10篇(Multiagent Systems (cs.MA))

信息检索共22 ...