深入理解语言模型的突现能力

最近,人们对大型语言模型所展示的强大能力(例如思维链、便签本)产生了极大的兴趣,并开展了许多工作。我们将之统称为大模型的突现能力,这些能力可能只存在于大型模型中,而不存在于较小的模型中,因此称为“突现”。其中许多能力都非常令人印象深刻,比如复杂推理、知识推理和分布外鲁棒性,我们将在后面详细讨论。值得注意的是,这些能力很接近 NLP 社区几十年来一直寻求的能力,因此代表了一种潜在的研究范式转变,即从微调小模型到使用大模型进行上下文学习。对于先行者来说,范式转变可能是很显然的。然而,出于科学的严谨性,我们确实需要非常明确的理由来说明为什么人们应该转向大型语言模型,即使这些模型昂贵、难以使用,并且效果可能一般。在本文中,我们将仔细研究这些能力是什么,大型语言模型可以提供什么,以及它们在更广泛的 NLP / ML 任务中的潜在优势是什么。

前提: 我们假设读者具备以下知识:

预训练、精调、提示(普通从业者应具备的自然语言处理/深度学习能力)

思维链提示、便签本(普通从业者可能不太了解,但不影响阅读)

存在于大模型而非小模型的突现能力

在以上的效果图中,我们可以观察到模型的表现:

当尺寸 ...

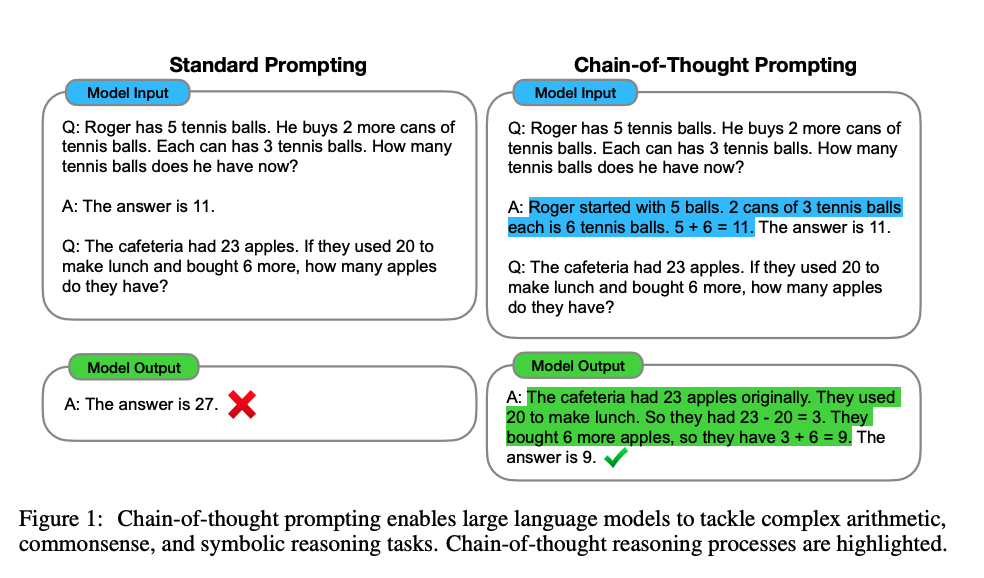

Chain of Thought Prompting Elicits Reasoning in Large Language Models

本文探讨了大型语言模型(LLM)产生一个连贯的思维链的能力——一系列的短句子,模仿一个人在回答一个问题时可能拥有的推理过程。通过Chain of Thoughts(CoT,即推理中间过程),提升大型语言模型(LLM)推理能力,在三个LLM上证明了CoT能够显著提升算术、常识、符号推理能力。

论文地址: https://arxiv.org/pdf/2201.11903.pdf

方法

语言模型的规模达到 100B 的参数量之后,就能够在像情感分类 、主题分类等这种分类任务上取得非常好的结果,作者将这类任务归纳为 system-1,也就是能够人类很快很直观地理解的任务。还有一类任务需要很慢而且是很仔细的考虑,作者将其归纳为 system-2 (比如一些设计逻辑、常识的推理任务),作者发现,即便语言模型的规模达到了几百B的参数量,也很难在 system-2 这类任务上获得很好的表现。

作者将这种现象称为 flat scaling curves:如果将语言模型参数量作为横坐标,在 system-2 这类任务上的表现作为纵坐标,则折线就会变得相当平缓,不会像在 system-1 这类任务上那么容 ...

Git速查表

本速查表基于 git 2.24 书写, 为必填参数, [param] 为选填参数, 使用前建议先看一遍 Pro Git , 请使用ctrl+f进行搜索。

配置

git config --list [–system|–global|–local] 显示当前配置

git config [–system|–global|–local] 设置参数

git config -e [–system|–global|–local] 编辑配置

git config --global alias. “” 创建别名

git 使用别名

git config --global --unset 移除单个变量

git config --global --unset-all 移除所有变量

设置例子

1234567# 设定身份git config --global user.name "cheatsheet"git config --global user.email "cheatsheet@cheatsheet.wang"# 首选编辑器git config - ...

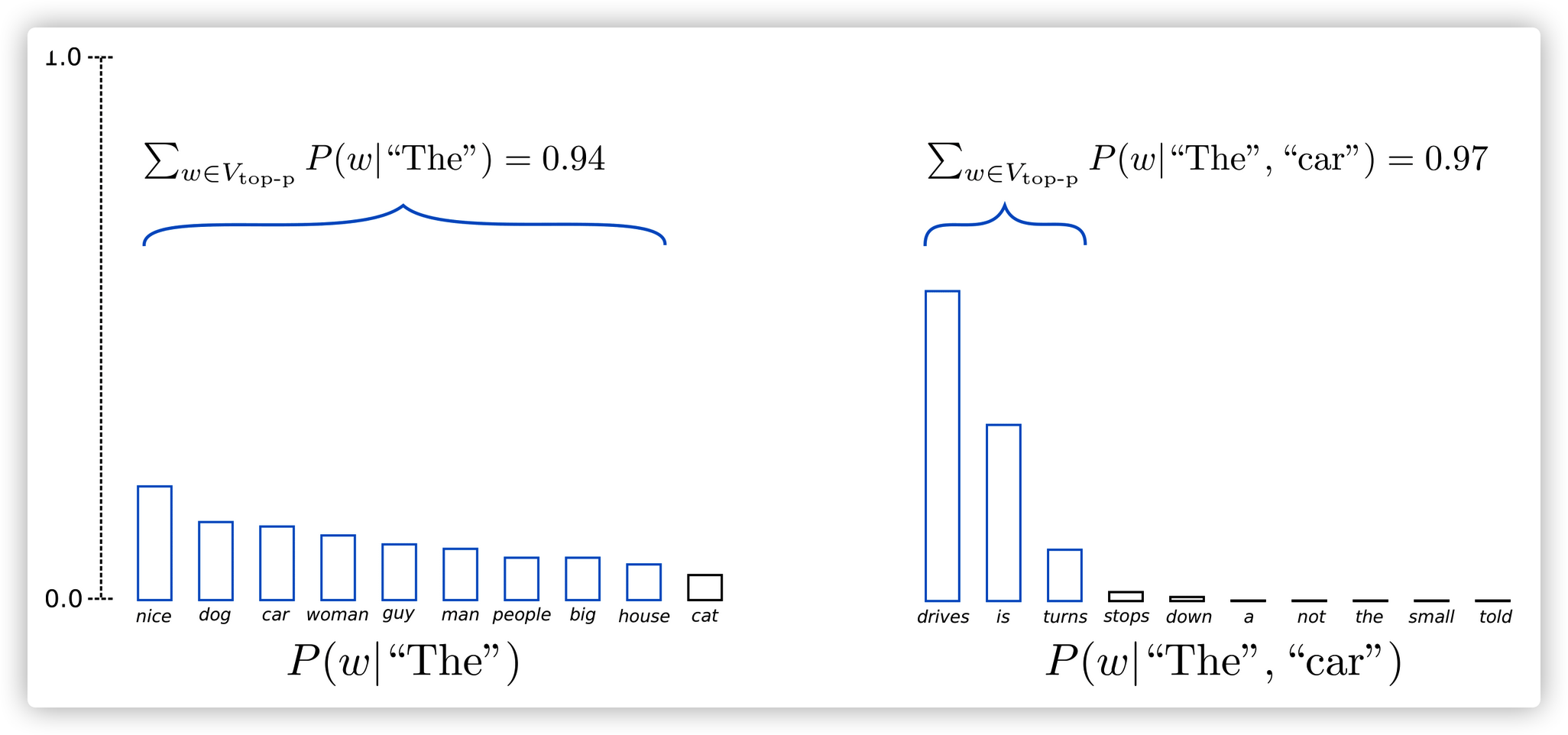

Transformers-文本生成的解码方法介绍

最近几年,以OpenAI公司的GPT3为代表,基于Transformer结构的大模型都已经开始在上百万级别的网页上面训练。因此大家对开放领域语言生成的期待值也越来越高。开放领域的条件语言生成效果也日新月异,例如GPT2、XLNet、CTRL。除了transformers结构和海量的无监督预训练数据,更好的解码方法也在其中扮演了重要角色。

这篇博客简要回顾了多种解码策略,帮助你用transformers库实现他们。

所有的方法都可以通过自回归(auto-regressive)语言生成实现新手导航,简而言之,自回归语言生成就是基于当前的词分布,预测下一个词的概率分布。

P(w1:T∣W0)=∏t=1TP(wt∣w1:t−1,W0),with w1:0=∅P(w_{1:T}|W_0) = \prod_{t=1}^TP(w_t|w_{1:t-1},W_0), with\ w_{1:0}=\emptyset

P(w1:T∣W0)=t=1∏TP(wt∣w1:t−1,W0),with w1:0=∅

这里W0W_0W0表示生成前的初始词序列,生成词序列的长度TTT取决于生成概率中P(w ...

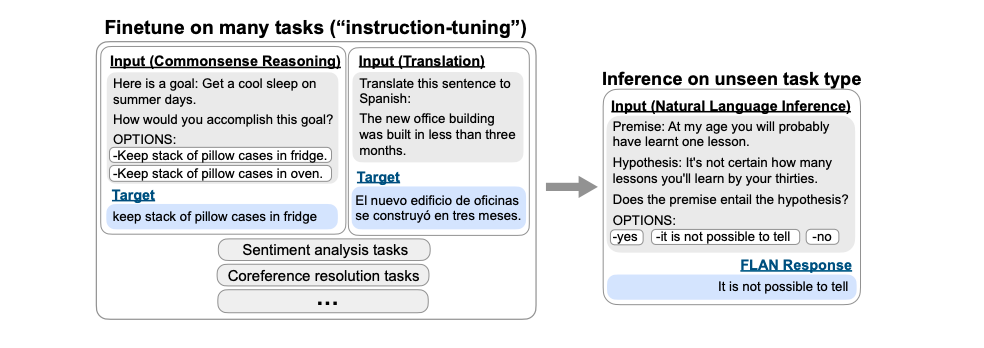

Finetuned Language Models are Zero-Shot Learners

本文探讨了一种简单的方法来提高大型语言模型在零样本情况下的性能,名为instruction tuning,它在多个数据集集合上微调语言模型,从而大大提高了未知任务上的零样本性能。本文采用一个137B参数的大型语言模型, 通过自然语言指令模板在60多个NLP数据集上进行instruction tune。本文将这个instruction-tuned模型称为FLAN,并在unseen任务上对模型进行评估。结果表明,FLAN在25个数据集中的20个上超过了零样本学习的175B GPT-3。FLAN甚至在ANLI、RTE、BoolQ、AI2-ARC、OpenbookQA和StoryCloze上都远远优于few-shot小样本学习的GPT-3。消融研究表明,微调数据集的数量、模型规模和自然语言指令是 instruction tuning 成功的关键。

论文地址: https://openreview.net/forum?id=gEZrGCozdqR

FLAN

Instruction Tuning和Prompt的核心一样,就是去发掘语言模型本身具备的知识。而他们的不同点就在于,Prompt是去激发 ...

(转)BERT加速的N种方法

从BERT面世的第二天,笔者就实现了BERT用于序列标注的工作,几乎是全网最早的用BERT做序列标注的工作,到今天离线场景下,BERT做序列标注已经成为一种普惠技术。从huggingface开源Transformers的几乎最早的时间开始跟进,复现组内早期基于Tensorflow做中文纠错的工作,之后模型侧的工作基本一直基于该框架完成。从BERT早期的一系列比较fancy的工作一直在跟进,到组内推广Transformers的使用,到如今PyTorch地位飙升,Transformers社区受众极广,BERT几乎是笔者过去很长一段时间经常讨论的话题。

但是,围绕BERT,最为诟病的一个问题:模型太重,inference时间太长,效果好,但是在线场景基本不能使用?

围绕该问题,学术界和工业界有太多的工作在做。这篇文章简单梳理一些具体的研究方向,同时围绕笔者个人比较感兴趣的一个方向,做一些评测和对比。

那么,具有有哪些研究方向呢?整体上,有两种观察视角。一种是train和inference,另一种是算法侧和工程侧,这里不做具体的区分。

模型大,是慢的一个重要原因,那就换小模型

模型大,通过模 ...

QQ浏览器搜索中的智能问答技术

智能问答是人工智能领域中一个比较受关注的方向,目前广泛应用于各种垂直或综合的搜索引擎、智能客服、智能助手以及智能手机、车载音箱等。本次分享的主题是QQ浏览器搜索中的智能问答技术。

问答在搜索中的应用

问答的核心是通过理解语言和运用知识来进行提问和回答。从应用角度看,由于人类有获取信息的需求和旺盛的好奇心,问答的场景无处不在;从研究角度看,问答是认知智能的前沿之一。

问答在搜索场景的应用可以分为两类。一类是满足用户的直接搜索需求,即在搜索结果页给用户提供精准的答案,例如Top1问答卡片。另一类是通过问答的方式与用户交互,来帮助用户澄清、细化和延伸需求,例如推荐和对话形式的问答。

搜索中的Top1问答

下图展示了QQ浏览器搜索中Top1问答的一些产品形态,包括短答案、长答案、列表答案、视频答案、集合和图片答案。

搜索问答技术与系统

搜索中问答的明确需求占比接近1/4。这些问题不限领域,不限类型,一般可分成事实类和非事实类。搜索中问答的数据源是多种多样的。从资源类型上看,包括网页、UGC(用户生产内容,如社区问答)和PGC(专业生产内容,例如自媒体号)。从文本的组织形态上来讲,数据可以 ...

算法模型部署

有一段时间,我一直专注于机器学习的研究工作,为不同的任务开发定制的机器学习解决方案。 但是最近,新项目接踵而至,有时自己完成初始部署比寻求其他开发人员的帮助更快。我找到了几种部署方案,它们在规模、易用性、价格等方面各有不同。

今天,我们将讨论一种简单而强大的机器学习模型部署方法。 它允许我们同时处理多个请求并在需要时扩展应用程序。 我们还将讨论数据科学家在将机器学习模型投入生产时的职责,以及如何使用一些方便的 Python 工具对 Web 应用程序进行负载测试。

1、数据科学家的职责

你几乎可以为每项任务找到大量开源解决方案。 一些现有服务甚至可以处理数据验证和处理、数据存储、模型训练和评估、模型推理和监控等。

但是,如果你仍然需要定制解决方案怎么办? 你必须自己开发整个基础架构。 这就是我一直在思考的问题:数据科学家到底负责什么? 它只是模型本身,还是我们必须将其投入生产?

通常,数据科学家的职责因公司而异。 我和我的首席技术官讨论了这个问题。 我们讨论了数据科学家应该具备专业知识的一些案例。 他们应该能够将他们的解决方案作为 API 交付,将其容器化,并且理想情况下,开发解决方案以 ...

GAIIC2022商品标题识别二等奖获奖解决思路

简介

本方案由大华DahuaKG团队提供,在本次竞赛中本方案获二等奖。DahuaKG团队由来自浙江大华技术股份有限公司大数据研究院知识图谱团队的成员组成,大华知识图谱团队专注于行业知识图谱构建和自然语言处理等技术的研究与应用,并致力于相关技术在语义检索、信息提取、文本理解、图挖掘、智能交互等任务上完成产业落地,为大华数据智能解决方案提供NLP和知识图谱相关领域的算法支撑。

整体上,我们基于预训练语言模型NeZha构建商品标题实体识别模型,通过继续预训练加微调的训练范式学习模型参数,并有效结合数据增强、损失函数优化、对抗训练等手段逐步提升模型性能。该方案简单有效,复现流程不超过36小时,线上推断1万条样本仅需254秒(NVIDIA T4,单卡)。

赛题介绍

赛题链接:https://www.heywhale.com/home/competition/620b34ed28270b0017b823ad

本赛题要求选手用模型抽取出商品标题文本中的关键信息,是典型的命名实体识别任务。要求准确抽取商品标题中的相关实体,有助于提升检索、推荐等业务场景下的用户体验和平台效率,是电商平台一项核心的基础任 ...

英文学术论文撰写投稿技巧

很多初学者同学在投稿的时候经常会出现一些共有的小错误,为了节省大家的时间和帮助大家能够尽快的定位一些小的问题。本项目总结了我们在自己投稿过程中的经验和一些身边老师同学的投稿经验,希望能对大家有所帮助,由于我们的水平有限,如有疏漏,还望谅解。谢谢大家。

本项目的特色:

写前必看:包含一些常见的错误,每个错误均配有例子,可以在动手写论文之前快速浏览。

终稿必查:包含一些例子,方便快速定位是否自己的论文有错误。

百家之言:整理了一些网络上公开的写作资源(并不完全,欢迎补充),方便大家系统学习。

免责声明

本项目列举的所有技巧仅供参考,并不保证正确。本文主要关注于顶会论文,论文写作以实际需求为准。熟悉写作技巧可能会使写作没有明显的失误,而优秀的论文需要不断打磨。

所有内容仅仅来自于笔者的个人经验、互联网数据、笔者团队日常科研工作中的相关积累,以及笔者团队身边各位大佬的言传身教。有任何问题,欢迎提交 Issue 或 PR。另本项目所用徽章来自互联网,如侵犯了您的图片版权请联系我们删除,谢谢。

解释

下文中,标注"Attention"的内容,是目前组织者认为有(较为)明 ...