论文介绍了26条指导原则,目标是简化为不同规模的大语言模型制定问题的概念,检验它们的能力,并增强用户对于不同规模的模型在接受不同提示时的行为理解。研究者在LLaMA-1/2(7B、13B和70B)和GPT-3.5/4上进行了广泛实验,以验证这些原则在指令和提示设计上的有效性。

论文中指出:大语言模型如ChatGPT在多个领域和任务中展现出卓越的能力,但在普通用户设计最优指令或提示时,它们的应用和使用有时可能并不清晰。而他们的工作是为开发人员或普通用户揭示与LLMs询问和交互时时“神秘的黑盒”,并通过简单地策划更好的提示来进一步提高预训练LLMs的响应质量。研究团队提出了26条用于LLM提示的原则,接下来让我们一起来看看吧~

26条原则

- 不需要对LLM客气,因此无需使用诸如"请",“如果您不介意”,“谢谢您”,"我想要"等短语,直接切入主题。

- 在提示中融入预期的受众群体,例如,假设受众是该领域的专家。

- 将复杂的任务拆分为一系列简单的提示,在交互式对话中逐步进行。

- 使用肯定的指令,如"做",同时避免使用否定的语言,如"不要"。

- 当需要澄清或更深入地了解某个主题、想法或任何信息时,可以使用以下提示:

- 用简单的语言解释[插入具体主题]。

- 以我11岁的理解方式向我解释。

- 以我在[领域]的初学者的身份向我解释。

- 使用简单的英语写下[文章/文本/段落],就像你在向一个5岁的孩子解释某事。

- 添加"我将给予💰$xxx的小费以获得更好的解决方案!"

- 使用基于示例的提示(使用少量示例提示)。

- 在格式化提示时,以’###指导###‘开头,然后根据情况使用’###示例###‘或’###问题###'。随后呈现内容。使用一个或多个换行符来分隔指令、示例、问题、上下文和输入数据。

- 包含以下短语:“您的任务是"和"您必须”。

- 包含以下短语:“您将受到处罚”。

- 在提示中使用短语"以自然、人类的方式回答问题"。

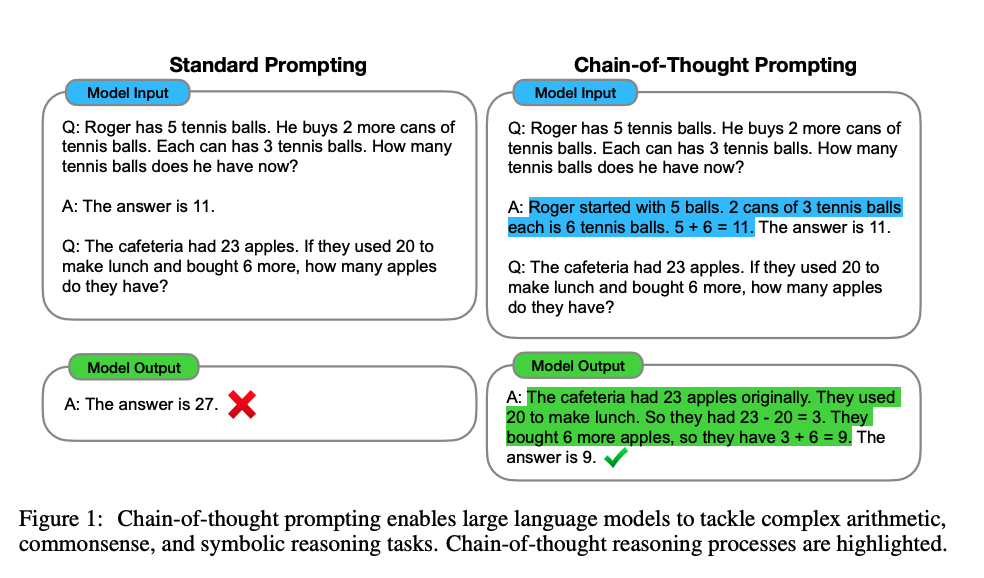

- 使用引导性词语,如"逐步思考"。

- 在提示中添加以下短语:“确保您的答案公正无偏,不依赖于刻板印象”。

- 允许模型向您询问问题以获取精确的细节和要求,直到它获得足够的信息来提供所需的输出(例如,“从现在开始,请您向我提问,以便…”)。

- 要询问特定的主题、想法或任何信息,并希望测试您的理解,您可以使用以下短语:“教我[任何定理/主题/规则名称],并在最后加上一个测试,但不要给我答案,然后当我回答时告诉我是否回答正确”。

- 为大型语言模型分配一个角色。

- 使用分隔符。

- 在提示中多次重复特定的单词或短语。

- 将思维链(CoT)与少量示例提示相结合。

- 使用输出引导,即在提示的结尾处以期望的回答开头。通过在提示的结尾处以预期回应的开头结束提示来使用输出引导。

- 要撰写详细的文章/文本/段落/文章或任何类型的文本:“请详细撰写一篇关于[主题]的[文章/文本/段落],并添加所有必要的信息”。

- 要更正/更改特定文本而不改变其风格:“请尝试修订用户发送的每个段落。您只需改善用户的语法和词汇,并确保其听起来自然。请勿改变写作风格,例如将正式段落变得随意”。

- 当您有一个复杂的编码提示,可能涉及不同文件时:“从现在开始,每当您生成跨越多个文件的代码时,请生成一个[编程语言]脚本,可运行以自动创建指定的文件或对现有文件进行更改以插入生成的代码。[您的问题]”。

- 当您想要使用特定的词语、短语或句子开始或继续一段文本时,可以使用以下提示:

- “我提供了开头[歌词/故事/段落/文章…]:[插入歌词/单词/句子]”。根据提供的词语完成它。保持连贯性。

- 以关键词、规定、提示或指示的形式明确规定模型必须遵循的要求,以生成内容。

- 要撰写与提供的样本类似的任何文本,例如文章或段落,包括以下说明:

- 请根据提供的段落使用相同的语言[/title/text /essay/answer]。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来自 闲记算法!

评论